ИИ как фактор конфликтов: может ли он развязать войну?

Искусственный интеллект (ИИ) становится все более важной частью нашей жизни, проникая в различные сферы: от медицины до финансов и даже обороны. Но наряду с пользой, которую он приносит, возникают и серьезные вопросы о его потенциальных угрозах. Одним из самых обсуждаемых вопросов является: может ли ИИ стать катализатором военных конфликтов? В этой статье мы попробуем разобраться в этом сложном вопросе, проанализировав различные аспекты использования ИИ в военной сфере, а также его влияние на международные отношения.

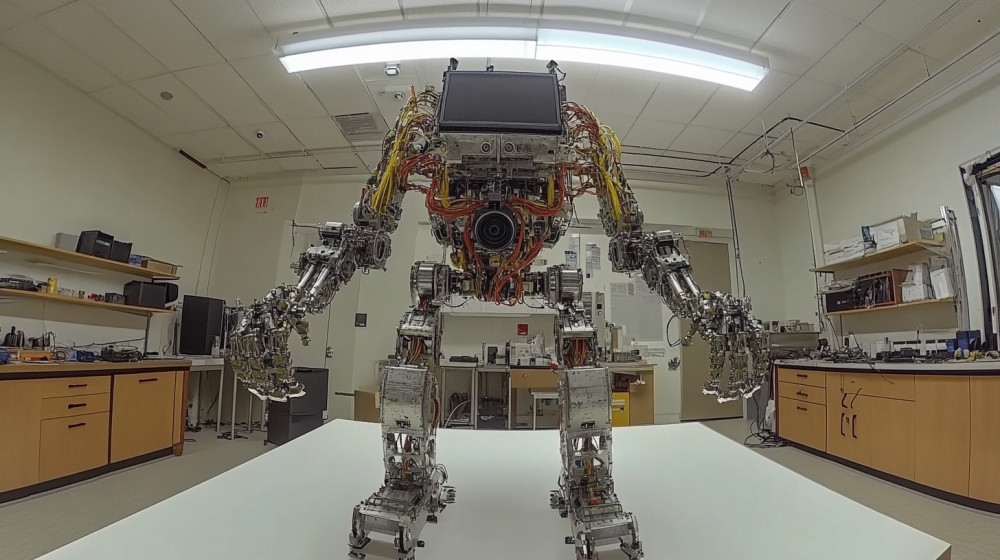

Искусственный интеллект в военных технологиях

На сегодняшний день множество стран активно внедряют технологии искусственного интеллекта в свои военные программы. Например, США, Китай и Россия значительно увеличили свои инвестиции в ИИ для военных нужд. По данным McKinsey, к 2025 году объем инвестиций в военные технологии, связанные с ИИ, может достичь 100 миллиардов долларов США.

В России, например, активно развиваются технологии автоматизированного управления беспилотниками и роботизированными боевыми системами. В 2019 году Министерство обороны РФ объявило о создании платформы «Умный беспилотник», которая, по заверениям разработчиков, позволит значительно повысить эффективность ведения боевых действий.

Риски автономных систем

Одним из самых больших рисков, связанных с использованием ИИ в военных целях, являются автономные боевые системы. Это устройства, способные принимать решения без участия человека. Например, дрон может самостоятельно выбирать цель на основе заранее заданных параметров.

Исследования показывают, что автономные системы могут быть подвержены сбоям или манипуляциям. В 2020 году BBC сообщала о том, как несколько беспилотников в Ливии были захвачены хакерами, которые использовали их для атаки на объекты противника. Это событие подчеркивает опасность, связанную с использованием ИИ в военной сфере — даже малейшая ошибка или вмешательство могут привести к непредсказуемым последствиям.

Непредсказуемость действий ИИ

Еще одной проблемой является непредсказуемость действий ИИ. Системы, работающие на основе машинного обучения, могут принимать решения, которые не всегда можно объяснить. Это становится особенно опасным в контексте военных конфликтов, где каждое неверное решение может стоить жизни людей.

Примером может служить инцидент с запуском ракеты в 2020 году, когда система обнаружения угрозы ошибочно посчитала гражданский самолет военной угрозой. Это привело к трагедии, в которой погибли 176 человек. Данная ситуация подчеркивает важность контроля и понимания ИИ в военных операциях.

Геополитические аспекты использования ИИ

Использование ИИ в военных операциях не только увеличивает существующие риски, но и вносит новые элементы в геополитическую динамику. Страны, обладающие более развитыми технологиями ИИ, могут получить значительное преимущество в конфликте, что ведет к гонке вооружений на основе ИИ.

По данным RAND Corporation, в ближайшие годы мы можем стать свидетелями нового этапа в развитии международных отношений, где технологическое преимущество станет решающим фактором. Это может привести к тому, что страны, отстающие в развитии технологий ИИ, будут вынуждены идти на компромиссы или даже вступать в альянсы с более развитыми государствами.

Примеры применения ИИ в гражданском секторе

Несмотря на риски, ИИ также активно используется в гражданском секторе, что, в свою очередь, может помочь предотвратить конфликты. Примеры включают:

- Медицина: ИИ помогает в диагностике заболеваний, обработке медицинских данных и создании персонализированных планов лечения.

- Финансы: Использование ИИ для анализа финансовых рынков и предотвращения мошенничества.

- Транспорт: Автономные транспортные средства, которые могут снижать количество ДТП и улучшать трафик.

Однако важно помнить, что негативное воздействие ИИ может перекреститься с гражданскими достижениями. Например, применение ИИ в системах мониторинга и контроля может привести к нарушениям прав человека.

Будущее ИИ и конфликты

Перспективы развития ИИ и его влияние на конфликты остается темой активных обсуждений. Ученые и эксперты рекомендуют, чтобы международное сообщество начало разработку этических норм и правил для использования ИИ в военных целях. Например, Фонд Картера предложил создать международную инициативу, которая будет сосредоточена на контроле и регулировании технологий ИИ в военно-промышленном комплексе.

Кроме того, необходимо стимулировать диалоги между странами для нахождения решений, которые помогут уменьшить риски, связанные с использованием ИИ в военных операциях. Важно понимать, что не только технологии, но и их использование определяют будущее мирных отношений.

Заключение

Искусственный интеллект обладает как большим потенциалом для улучшения качества жизни, так и значительными рисками, особенно в контексте военных конфликтов. Его использование в обороне может как способствовать улучшению безопасности, так и привести к непредсказуемым последствиям, что делает вопрос регулирования ИИ в военной сфере особенно актуальным. Чтобы минимизировать риски, необходимо активно работать над созданием международных норм и стандартов, которые помогут направить технологии на благо человечества.